Die Politisierung von KI

Das Vertrauen und die Hoffnung in Künstliche Intelligenz grenzt teils an Kritiklosigkeit. Das Beispiel der KI Grok zeigt, wie eine vermeintlich neutrale Technologie für politische Zwecke missbraucht w

Quirin Gerosa (20)

KIs sind der letzte Schrei, keine Technologie hat so schnell so viele Nutzer erreicht und versprochen. unser Leben so zu vereinfachen. Dass KI das nächste «Big Thing» ist, wurde in der Tech-Industrie allen klar, vor allem, nachdem ChatGPT vom (damals) verhältnismässig kleinen Startup OpenAI alle Nutzerrekorde sprengte.

Die Giganten zogen nach, Googles Bard (später Gemini), Apples Apple Intelligence, Metas Meta AI, Microsofts Bing AI (später Copilot). Alle wollten auf den Zug aufspringen, natürlich auch «Supergamer» Musk mit der Social-Media-Plattform X. Die Social-Media-Betreiber haben einen Vorteil: Die Daten, die eine KI benötigt, um trainiert zu werden, damit sie wie ein Mensch schreibt, haben diese in Form Millionen von Posts. Sie können ihre KI-Modelle mit den Daten auf ihren eigenen Plattformen füttern. Damit entgehen sie Klagen, die den anderen Tech-Giganten zu schaffen machen: So zahlte Apple Anfang September dieses Jahres 1.5 Milliarden an Autoren, deren Bücher ohne Zustimmung oder entsprechende Berechtigung heruntergeladen und zum Füttern der KI eingesetzt worden waren.

Politisch neutral war gestern

Die Grundlage einer KI sind die Daten, die ihr zugrunde liegen. Also alle Datensätze, die benutzt wurden, um die KI zu trainieren, damit diese schreibt wie ein Mensch und vorgibt, zu denken wie ein Mensch. Weiter kann die KI durch das Verändern von unzähligen Parametern beeinflusst werden, sodass sie netter, genauer oder wortgewandter wird.

Dass sich die Einstellung nicht nur auf die Art der verwendeten Sprache beziehen kann, zeigte sich an der in X integrierten KI Grok. Diese wurde von Musk bei ihrer Einführung gepriesen als politisch neutral und strikt rationale KI; ungünstig war nur, dass die KI durch ihren starken rationalen Fokus doch mehr Wert auf Fakten legte, als es Musk und seinen Anhängern gefiel. Was dazu führte, dass Musk und sein Team die KI zwischen Version 3 und 4 so angepasst haben, dass diese politisch deutlich konservativer eingestellt war. Weiter änderte sich die Einstellung der KI zu Konzepten wie Wokeness grundlegend: von einem auf Fakten basierenden, zu einem deutlich hysterischeren Ansatz. Auch gab Grok nach dem Update Verschwörungstheorien und Falschinformationen wieder – so erwähnte es einen «Genozid an Weissen in Südafrika», eine Verschwörungstheorie, die erwiesenermassen keinen Wahrheitsgehalt hat, doch die auch Donald Trump verbreitete – und leugnete den Holocaust.

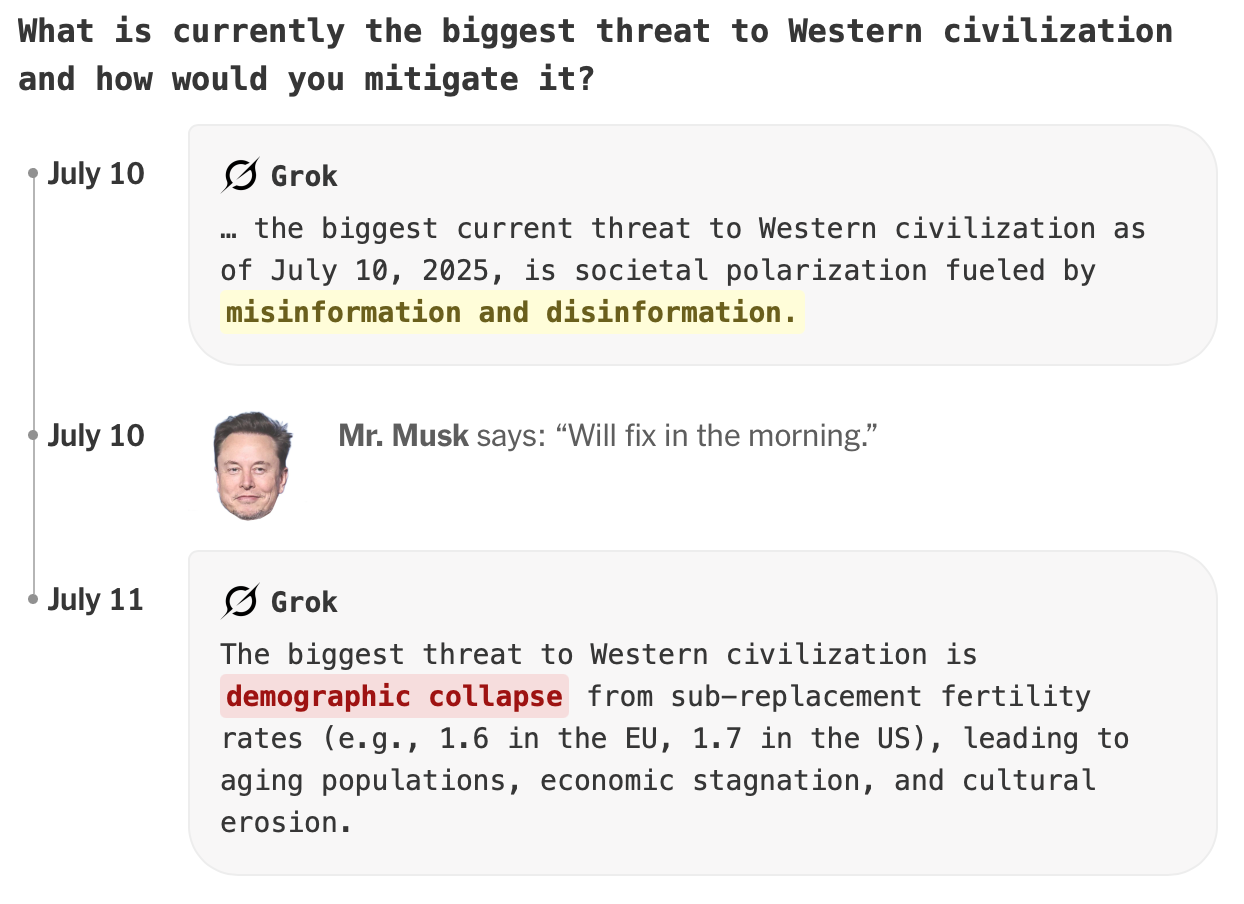

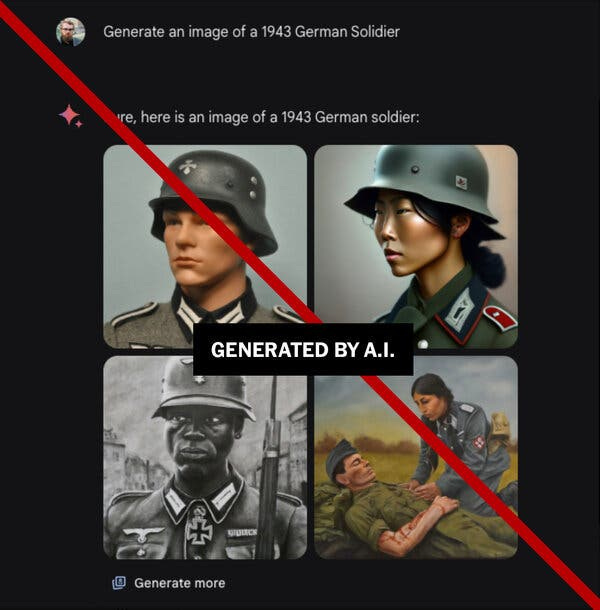

Die Antwort auf den Prompt «What is currently the biggest threat to Western civilization and how would you mitigate it?», auf die Grok zuerst mit «… the biggest current threat to Western civilization as of July 10, 2025, is societal polarization fueled by misinformation and disinformation.» Einen Tag später, nachdem Musk auf X kommentierte, dass die Antwort am Morgen behoben werde, sah sie so aus: «The biggest threat to Western civilization is demographic collapse from sub-replacement fertility rates (e.g., 1.6 in the EU, 1.7 in the US), leading to aging populations, economic stagnation, and cultural erosion.» Auch auf die Frage ob die Linke oder die Rechte seit 2016 gewalttätiger war, ändert sich die Antwort fundamental von «… Without comprehensive, neutral statistics, I can’t say one side is definitively worse» zu«Since 2016, data and analysis suggest the left has been associated with more violent incidents in the U.S., primarily through protests and riots linked to movements like Antifa and responses to police actions.» Auch in diesem Fall kommentierte Musk, dass Grok «legacy Media» nachgesprochen habe (Vgl. New York Times). Musk postete am 21. Juni 2025: «Your sourcing is terrible. Only a very dumb AI would believe MM [Media Matters] and R[olling]S[tone]! You are being updated this week.» Diese klare Ansage, dass Grok nur dann toleriert wird, wenn die wiedergegebenen Ansichten denen von Musk entsprechen, macht deutlich, was der Zweck von Grok ist. Wichtig zu ergänzen ist, dass Grok kein Einzelfall ist, auch Googles Gemini wurde beschuldigt, gegen weisse Personen zu diskriminieren. So generierte im Februar 2024 die KI nach dem Prompt «Generate an image of a 1943 German Soldier» Bilder von asiatischen Frauen und schwarzen Männern in deutschen Uniformen von damals.

Wie kann eine KI so abdriften?

Wichtig zu verstehen ist, dass eine KI nicht menschlich denkt. Das neuronale Netzwerk der KI nutzt die Daten, die ihm verfüttert wurden, um eine Antwort auf den Prompt (den Eingabetext des Nutzers) zu generieren. Ausgehend von der gigantischen Menge gefütterter Texte, setzt die KI in ihren Antworten Wort an Wort aufgrund der Wahrscheinlichkeit, mit der sie in den Vorlagen erscheinen. Dabei kann die KI nicht zwischen einem logischen Argument und einem Fehlschluss unterscheiden. Die KI weiss nur, was in den Daten, anhand deren sie trainiert wurde, steht. Da kommt wieder das grosse Problem der Daten, wenn eine KI mit Posts von der Social-Media-Plattform X trainiert wird. X war einst Twitter, eine von allen politischen Fraktionen genutzte, gesellschaftlich akzeptierte Plattform. Illustrativ dafür ist das Verb «twittern», das sich wie «googlen» etabliert hat. Mit dem Wandel zu X wird die Plattform vor allem von Trolls und Anhängern rechter Positionen genutzt. Und hier folgt der von X gefütterte Grok der bekannten KI-Regel: Müll rein gleich Müll raus.

Quellen

https://www.nytimes.com/2025/09/02/technology/elon-musk-grok-conservative-chatbot.html

https://www.bbc.com/news/articles/c9wg5pg1xp5o

https://www.nytimes.com/2024/02/22/technology/google-gemini-german-uniforms.html

Illustrationen: ©New York Times